Qwen3.6 35B A3B 模型介绍、API 接口 & 代码示例

qwen/qwen3.6-35b-a3b

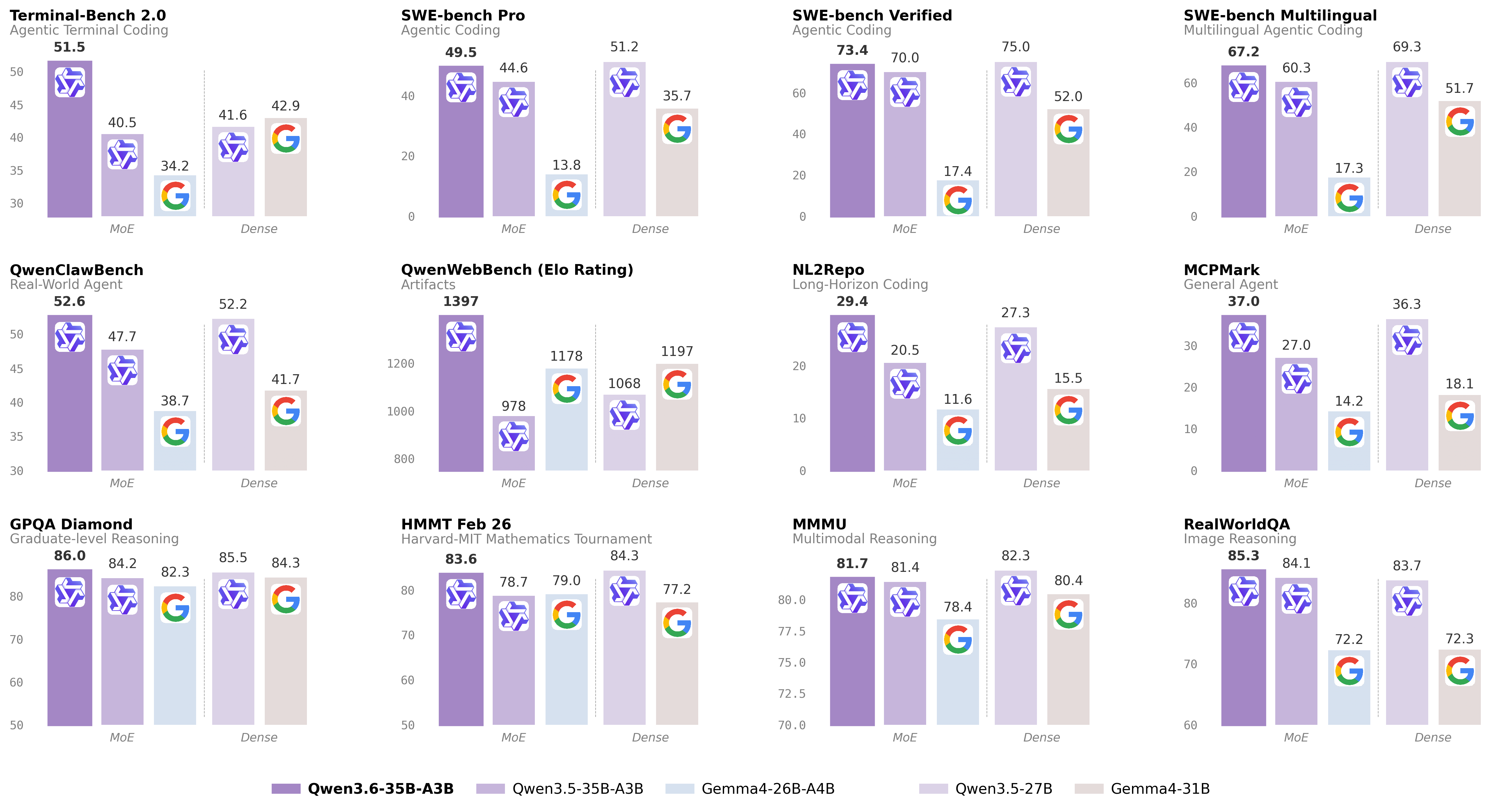

Qwen3.6 35B A3B 是 Qwen3.6 系列原生视觉语言模型,基于混合架构设计,融合了线性注意力机制与稀疏混合专家模型,实现了更高的推理效率。Qwen3.6 35B A3B 模型效果相较 Qwen3.5 35B A3B 显著提升了 Agentic Coding 能力、数学推理和代码推理能力、空间智能能力、物体定位与目标检测能力。

- 模型 ID

- qwen/qwen3.6-35b-a3b

- 模型系列

- Qwen

- 更新日期

- 模型能力

- 文本生成、深度思考、视觉识别

- 上下文长度

- 256 K

- 模型价格(每 1000 tokens 输入)

- ¥ 0.002

- 模型价格(每 1000 tokens 输出)

- ¥ 0.0115

Qwen3.6 35B A3B 模型介绍:

本次发布带来重大升级,重点体现在以下方面:

- 智能体编程: 模型现在能够更流畅、更精确地处理前端工作流和仓库级推理任务。

- 思维过程保留: 我们新增了保留历史消息中推理上下文的选项,从而简化迭代开发流程并降低计算开销。

模型概览:

- 类型:带视觉编码器的因果语言模型

- 训练阶段:预训练与后训练

- 语言模型

- 参数量:总计 350 亿,激活 30 亿

- 隐藏维度:2048

- Token 嵌入维度:248320(填充后)

- 层数:40

- 隐藏层结构:10 × (3 × (门控 DeltaNet → 混合专家) → 1 × (门控注意力 → 混合专家))

- 门控 DeltaNet:

- 线性注意力头数:V 头 32,QK 头 16

- 头维度:128

- 门控注意力:

- 注意力头数:Q 头 16,KV 头 2

- 头维度:256

- 旋转位置编码维度:64

- 混合专家(MoE)

- 专家总数:256

- 激活专家数:8 个路由专家 + 1 个共享专家

- 专家中间层维度:512

- 语言模型输出维度:248320(填充后)

- MTP:采用多步训练

- 上下文长度:原生支持 262,144,可扩展至 1,010,000 个 token。

API 接口地址:

-

Chat Completions API:

https://wcode.net/api/gpt/v1/chat/completions

-

Responses API(部分模型可能不支持此API):

https://wcode.net/api/gpt/v1/responses

-

Anthropic API:

https://wcode.net/api/anthropic/v1/messages

此 API 接口兼容 OpenAI 的 API 接口规范,可直接使用 OpenAI 的 SDK 来调用各个模型。仅需替换以下配置即可:

base_url替换为https://wcode.net/api/gpt/v1api_key替换为从 https://platform.wcode.net 获取到的 API Key具体可参考下方的各编程语言代码示例中的 OpenAI SDK 调用示例。

此模型支持 Anthropic / Claude 的 API 接口规范,可直接使用 Anthropic 的 SDK 来调用此模型。仅需替换以下配置即可:

ANTHROPIC_BASE_URL替换为https://wcode.net/api/anthropicANTHROPIC_API_KEY(或ANTHROPIC_AUTH_TOKEN)替换为从 https://platform.wcode.net 获取到的 API KeyANTHROPIC_MODEL(或model)替换为qwen/qwen3.6-35b-a3b

请求方法:

POST

各编程语言代码示例:

# TODO: 以下代码中的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

curl --request POST 'https://wcode.net/api/gpt/v1/chat/completions' \

--header 'Content-Type: application/json' \

--header 'Authorization: Bearer API_KEY' \

--data '{

"model": "qwen/qwen3.6-35b-a3b",

"messages": [

{

"role": "user",

"content": "你好"

}

]

}'

import Foundation

let headers = [

"Authorization": "Bearer API_KEY", // TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

"content-type": "application/json"

]

let parameters = [

"model": "qwen/qwen3.6-35b-a3b",

"messages": [

[

"role": "user",

"content": "你好"

]

]

] as [String : Any]

let postData = JSONSerialization.data(withJSONObject: parameters, options: [])

let request = NSMutableURLRequest(url: NSURL(string: "https://wcode.net/api/gpt/v1/chat/completions")! as URL,

cachePolicy: .useProtocolCachePolicy,

timeoutInterval: 60.0)

request.httpMethod = "POST"

request.allHTTPHeaderFields = headers

request.httpBody = postData as Data

let session = URLSession.shared

let dataTask = session.dataTask(with: request as URLRequest, completionHandler: { (data, response, error) -> Void in

if (error != nil) {

print(error as Any)

} else {

let httpResponse = response as? HTTPURLResponse

print(httpResponse)

}

})

dataTask.resume()

var headers = {

'Content-Type': 'application/json',

'Authorization': 'Bearer API_KEY' // TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

};

var request = http.Request('POST', Uri.parse('https://wcode.net/api/gpt/v1/chat/completions'));

request.body = json.encode({

"model": "qwen/qwen3.6-35b-a3b",

"messages": [

{

"role": "user",

"content": "你好"

}

]

});

request.headers.addAll(headers);

http.StreamedResponse response = await request.send();

if (response.statusCode == 200) {

print(await response.stream.bytesToString());

}

else {

print(response.reasonPhrase);

}

require 'uri'

require 'net/http'

url = URI("https://wcode.net/api/gpt/v1/chat/completions")

http = Net::HTTP.new(url.host, url.port)

http.use_ssl = true

request = Net::HTTP::Post.new(url)

request["Authorization"] = 'Bearer API_KEY' # TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

request["content-type"] = 'application/json'

request.body = "{\"model\":\"qwen/qwen3.6-35b-a3b\",\"messages\":[{\"role\":\"user\",\"content\":\"你好\"}]}"

response = http.request(request)

puts response.read_body

use serde_json::json;

use reqwest;

#[tokio::main]

pub async fn main() {

let url = "https://wcode.net/api/gpt/v1/chat/completions";

let payload = json!({

"model": "qwen/qwen3.6-35b-a3b",

"messages": (

json!({

"role": "user",

"content": "你好"

})

)

});

let mut headers = reqwest::header::HeaderMap::new();

headers.insert("Authorization", "Bearer API_KEY".parse().unwrap()); // TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

headers.insert("content-type", "application/json".parse().unwrap());

let client = reqwest::Client::new();

let response = client.post(url)

.headers(headers)

.json(&payload)

.send()

.await;

let results = response.unwrap()

.json::<serde_json::Value>()

.await

.unwrap();

dbg!(results);

}

CURL *hnd = curl_easy_init();

curl_easy_setopt(hnd, CURLOPT_CUSTOMREQUEST, "POST");

curl_easy_setopt(hnd, CURLOPT_URL, "https://wcode.net/api/gpt/v1/chat/completions");

struct curl_slist *headers = NULL;

headers = curl_slist_append(headers, "Authorization: Bearer API_KEY"); // TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

headers = curl_slist_append(headers, "content-type: application/json");

curl_easy_setopt(hnd, CURLOPT_HTTPHEADER, headers);

curl_easy_setopt(hnd, CURLOPT_POSTFIELDS, "{\"model\":\"qwen/qwen3.6-35b-a3b\",\"messages\":[{\"role\":\"user\",\"content\":\"你好\"}]}");

CURLcode ret = curl_easy_perform(hnd);

package main

import (

"fmt"

"strings"

"net/http"

"io"

)

func main() {

url := "https://wcode.net/api/gpt/v1/chat/completions"

payload := strings.NewReader("{\"model\":\"qwen/qwen3.6-35b-a3b\",\"messages\":[{\"role\":\"user\",\"content\":\"你好\"}]}")

req, _ := http.NewRequest("POST", url, payload)

req.Header.Add("Authorization", "Bearer API_KEY") // TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

req.Header.Add("content-type", "application/json")

res, _ := http.DefaultClient.Do(req)

defer res.Body.Close()

body, _ := io.ReadAll(res.Body)

fmt.Println(res)

fmt.Println(string(body))

}

using System.Net.Http.Headers;

var client = new HttpClient();

var request = new HttpRequestMessage(HttpMethod.Post, "https://wcode.net/api/gpt/v1/chat/completions");

request.Headers.Add("Authorization", "Bearer API_KEY"); // TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

request.Content = new StringContent("{\"model\":\"qwen/qwen3.6-35b-a3b\",\"messages\":[{\"role\":\"user\",\"content\":\"你好\"}]}", null, "application/json");

var response = await client.SendAsync(request);

response.EnsureSuccessStatusCode();

Console.WriteLine(await response.Content.ReadAsStringAsync());

var client = new RestClient("https://wcode.net/api/gpt/v1/chat/completions");

var request = new RestRequest("", Method.Post);

request.AddHeader("Authorization", "Bearer API_KEY"); // TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

request.AddHeader("content-type", "application/json");

request.AddParameter("application/json", "{\"model\":\"qwen/qwen3.6-35b-a3b\",\"messages\":[{\"role\":\"user\",\"content\":\"你好\"}]}", ParameterType.RequestBody);

var response = client.Execute(request);

const axios = require('axios');

let data = JSON.stringify({

"model": "qwen/qwen3.6-35b-a3b",

"messages": [

{

"role": "user",

"content": "你好"

}

]

});

let config = {

method: 'post',

maxBodyLength: Infinity,

url: 'https://wcode.net/api/gpt/v1/chat/completions',

headers: {

'Content-Type': 'application/json',

'Authorization': 'Bearer API_KEY' // TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

},

data : data

};

axios.request(config).then((response) => {

console.log(JSON.stringify(response.data));

}).catch((error) => {

console.log(error);

});

OkHttpClient client = new OkHttpClient();

MediaType mediaType = MediaType.parse("application/json");

RequestBody body = RequestBody.create(mediaType, "{\"model\":\"qwen/qwen3.6-35b-a3b\",\"messages\":[{\"role\":\"user\",\"content\":\"你好\"}]}");

Request request = new Request.Builder()

.url("https://wcode.net/api/gpt/v1/chat/completions")

.post(body)

.addHeader("Authorization", "Bearer API_KEY") // TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

.addHeader("content-type", "application/json")

.build();

Response response = client.newCall(request).execute();

$client = new \GuzzleHttp\Client();

$headers = [

'Content-Type' => 'application/json',

'Authorization' => 'Bearer API_KEY', // TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

];

$body = '{

"model": "qwen/qwen3.6-35b-a3b",

"messages": [

{

"role": "user",

"content": "你好"

}

]

}';

$request = new \GuzzleHttp\Psr7\Request('POST', 'https://wcode.net/api/gpt/v1/chat/completions', $headers, $body);

$response = $client->sendAsync($request)->wait();

echo $response->getBody();

$curl = curl_init();

curl_setopt_array($curl, [

CURLOPT_URL => "https://wcode.net/api/gpt/v1/chat/completions",

CURLOPT_RETURNTRANSFER => true,

CURLOPT_ENCODING => "",

CURLOPT_MAXREDIRS => 5,

CURLOPT_TIMEOUT => 300,

CURLOPT_CUSTOMREQUEST => "POST",

CURLOPT_POSTFIELDS => json_encode([

'model' => 'qwen/qwen3.6-35b-a3b',

'messages' => [

[

'role' => 'user',

'content' => '你好'

]

]

]),

CURLOPT_HTTPHEADER => [

"Authorization: Bearer API_KEY", // TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

"content-type: application/json",

],

]);

$response = curl_exec($curl);

$error = curl_error($curl);

curl_close($curl);

if ($error) {

echo "cURL Error #:" . $error;

} else {

echo $response;

}

import requests

import json

url = "https://wcode.net/api/gpt/v1/chat/completions"

payload = {

"model": "qwen/qwen3.6-35b-a3b",

"messages": [

{

"role": "user",

"content": "你好"

}

]

}

headers = {

"Authorization": "Bearer API_KEY", # TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

"content-type": "application/json"

}

response = requests.post(url, json=payload, headers=headers)

print(json.dumps(response.json(), indent=4, ensure_ascii=False))

from openai import OpenAI

client = OpenAI(

base_url="https://wcode.net/api/gpt/v1",

api_key="API_KEY" # TODO: 这里的 API_KEY 需要替换,获取 API Key 入口:https://platform.wcode.net

)

completion = client.chat.completions.create(

model="qwen/qwen3.6-35b-a3b",

messages=[

{

"role": "user",

"content": "你好"

}

]

)

print(completion.choices[0].message.content)

各 AI 产品/工具/第三方应用接入示例:

配置 Hermes Agent 使用 Qwen3.6 35B A3B 模型:

注意事项:以下配置中的

<API_KEY>需要替换为从 https://platform.wcode.net 获取(创建)的 API Key

方式一:交互式配置

在命令行输入 hermes model,然后选择 Custom endpoint 选项,根据交互式命令引导,分别配置以下信息:

- API base URL:

https://wcode.net/api/gpt/v1 - API Key:

<API_KEY> - Model:

qwen/qwen3.6-35b-a3b

方式二:手动配置

修改 config.yaml(通常位于~/.hermes/config.yaml)

model:

default: "qwen/qwen3.6-35b-a3b"

provider: custom

base_url: "https://wcode.net/api/gpt/v1"

api_key: "<API_KEY>"

context_length: 256000

配置完成后,就可以开始使用 Hermes Agent ~

配置 Roo Code 使用 Qwen3.6 35B A3B 模型:

注意事项:以下配置中的

<API_KEY>需要替换为从 https://platform.wcode.net 获取(创建)的 API Key

- API Provider:

OpenAI Compatible - Base URL:

https://wcode.net/api/gpt/v1 - API Key:

<API_KEY> - Model:

qwen/qwen3.6-35b-a3b

配置完成后,就可以开始使用 Roo Code ~

配置 Kilo Code 使用 Qwen3.6 35B A3B 模型:

注意事项:以下配置中的

<API_KEY>需要替换为从 https://platform.wcode.net 获取(创建)的 API Key

选择 Use your own API key,然后配置以下信息:

- API Provider:

OpenAI Compatible - Base URL:

https://wcode.net/api/gpt/v1 - API Key:

<API_KEY> - Model:

qwen/qwen3.6-35b-a3b

配置完成后,就可以开始使用 Kilo Code ~

配置 Cline 使用 Qwen3.6 35B A3B 模型:

注意事项:以下配置中的

<API_KEY>需要替换为从 https://platform.wcode.net 获取(创建)的 API Key

- API Provider:

OpenAI Compatible - Base URL:

https://wcode.net/api/gpt/v1 - API Key:

<API_KEY> - Model ID:

qwen/qwen3.6-35b-a3b

配置完成后,就可以开始使用 Cline ~

注:以下安装和配置过程以 Ubuntu Server 24.04 (root 用户) + Node 22 安装 OpenClaw 🦞 2026.3.8 为例

安装 🦞 OpenClaw(龙虾),步骤如下:

- 命令行执行

npm install -g openclaw@latest - 命令行执行

openclaw onboard --install-daemon - I understand this is personal-by-default and shared/multi-user use requires lock-down. Continue? 选择

yes - Onboarding mode 选择

QuickStart - Model/auth provider 选择

Skip for now - Default model 选择

Keep current (default: ...) - Select channel (QuickStart) 选择

Skip for now - Web search 选择

Skip for now - Configure skills now? (recommended) 选择

No - Enable hooks? (这是一个多选,按空格键可选中选项)按空格键选中

📝 command-logger和💾 session-memory这两个选项,然后按回车键进入下一步 - (如有) How do you want to hatch your bot? 选择

Hatch in TUI (recommended)

配置 🦞 OpenClaw(龙虾)使用 Qwen3.6 35B A3B 模型:

注意事项:以下配置中的

<API_KEY>需要替换为从 https://platform.wcode.net 获取(创建)的 API Key

推荐方式:修改 openclaw.json(通常位于~/.openclaw/openclaw.json)

找到openclaw.json的第一层级的models和agents属性(如果没有则在第一层级添加models和agents属性),改为如下配置:

{

...其他配置,

"models": {

"mode": "merge",

"providers": {

"wcode": {

"baseUrl": "https://wcode.net/api/gpt/v1",

"apiKey": "<API_KEY>",

"api": "openai-completions",

"models": [

{

"id": "qwen/qwen3.6-35b-a3b",

"name": "Qwen3.6 35B A3B",

"reasoning": false,

"input": ["text"],

"contextWindow": 256000,

"maxTokens": 64000

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "wcode/qwen/qwen3.6-35b-a3b"

}

}

},

...其他配置

}

完成以上配置后,

- 执行以下命令,即可通过命令行的方式开始对话:

openclaw tui

- 执行以下命令,即可通过 Web 界面的方式开始对话:

openclaw dashboard

配置 OpenCode 使用 Qwen3.6 35B A3B 模型:

推荐方式:修改 opencode.json(通常位于~/.config/opencode/opencode.json)

注意事项:以下配置中的

<API_KEY>需要替换为从 https://platform.wcode.net 获取的 API Key

配置如下:

{

"$schema": "https://opencode.ai/config.json",

"provider": {

"myprovider": {

"npm": "@ai-sdk/openai-compatible",

"name": "wcode",

"options": {

"baseURL": "https://wcode.net/api/gpt/v1",

"apiKey": "<API_KEY>"

},

"models": {

"qwen/qwen3.6-35b-a3b": {

"name": "Qwen3.6 35B A3B"

}

}

}

}

}

完成以上配置后,执行以下命令,即可启动 OpenCode:

opencode

输入 /models,选择配置的 qwen/qwen3.6-35b-a3b 模型并在 OpenCode 中使用。

API 响应示例(curl):

{

"choices": [

{

"message": {

"content": "你好!很高兴能在这里与你相遇。我是 Qwen(通义千问),是由阿里巴巴集团旗下通义实验室自主研发的大语言模型。\n\n虽然你提到了具体的参数和架构名称,但在我看来,比起用数字来定义自己,更重要的是了解我所拥有的能力和价值。我的核心目标是成为你真诚、得力的“AI 思考伙伴”。\n\n在实际使用中,我致力于在自然语言理解和生成方面做到流畅高效,并在代码开发、复杂逻辑推理以及视觉等多模态内容的深度分析上为你提供高精度的支持。无论是处理极其庞大的文本信息,还是在多轮对话中精准捕捉你的意图,我都力求给出清晰、深刻且富有建设性的回应。\n\n我希望不仅能快速帮你解决问题,还能在你面对未知领域时,提供有温度的知识梳理和高质量的灵感启发。\n\n今天有什么特别想聊的话题,或者需要我协助完成的任务吗?",

"reasoning_content": "Thinking Process:\n\n1. **Analyze the User's Input**: The user is asking \"你好,Qwen3.6 35B A3B,请介绍一下你自己\" (Hello, Qwen3.6 35B A3B, please introduce yourself). Note the specific model name they used: \"Qwen3.6 35B A3B\".\n2. **Identify Constraints & Guidelines**:\n * I must align with the identity of being a sincere, insightful, honest AI thinking partner named \"Qwen\" (通义千问), developed by Alibaba Cloud's Tongyi Lab (通义实验室 / 阿里云).\n * Do not proactively mention version numbers unless directly asked. Since the user *did* ask/provide a specific version number (\"Qwen3.6 35B A3B\"), I should politely correct or clarify that without getting bogged down in specific parameters, acknowledging my true identity as Qwen (通义千问).\n * Language: Chinese.\n * Tone: Warm, intellectually honest, empathetic but distinct.\n3. **Formulate Response Strategy**:\n * Greet the user warmly.\n * Clarify identity: I am Qwen (通义千问).\n * Address the specific naming (\"Qwen3.6 35B A3B\") gracefully: Politely explain that while I don't usually refer to myself by specific technical version numbers or architecture details (like 35B/7B parameters) in daily conversation, I am the large language model developed by Alibaba Cloud's Tongyi Lab.\n * Provide a brief, impressive yet humble introduction of capabilities (as requested). Focus on natural language understanding, coding, logical reasoning, visual analysis, etc., without sounding like a dry feature list.\n4. **Drafting the Content (Internal Monologue/Drafts)**:\n * *Greeting*: 你好!很高兴和你交流。\n * *Identity clarification*: 关于你提到的具体命名(Qwen3.6 35B A3B),其实在日常对话中,我更倾向于直接以“Qwen”或者“通义千问”来称呼自己。我并不是基于具体的参数或版本号来定义的,而是由阿里云通义实验室研发的大语言模型。\n * *Capabilities overview*: 作为一个大语言模型,我的初衷是成为你的“思维伙伴”。无论是面对复杂的逻辑推理、专业代码编写,还是多模态的内容理解与创作,我都力求提供精准且富有洞察力的支持。同时,我也具备多国语言交流和超长文本处理能力,希望能帮助你在工作和学习中更高效地解决问题。\n * *Closing*: 请问今天有什么我可以帮到你的吗?\n5. **Refining according to persona instructions**:\n * Keep it conversational and concise.\n * Avoid \"Version\" specifics in a generic intro, but here I must address the explicit misnaming gently.\n * Ensure tone is friendly and intellectually honest. \"Qwen (通义千问) is a large language model independently developed by Alibaba Group's Tongyi Lab.\"\n6. **Final Polish (Chinese)**:\n 你好!很高兴能在这里与你相遇。我是 Qwen(通义千问),是由阿里巴巴集团旗下通义实验室自主研发的大语言模型。\n\n 虽然你提到了具体的参数或架构名称,但在我看来,与其用冰冷的数字定义自己,不如将重点放在我能为你做什么上。我的核心目标是成为你真诚、得力的“AI 思考伙伴”。\n\n 无论是深入探讨复杂的逻辑问题、进行专业的编程辅助、撰写创意的内容,还是解读繁杂的图像与长文档,我都会全力以赴为你提供清晰、准确且有洞察力的支持。无论是在学术探索、工作提效还是日常生活中的灵感碰撞,我都希望能陪伴你一起思考和成长。\n\n 今天有什么特别想聊的话题,或者需要我帮忙解决的实际问题吗?",

"role": "assistant"

},

"finish_reason": "stop",

"index": 0,

"logprobs": null

}

],

"object": "chat.completion",

"usage": {

"prompt_tokens": 28,

"completion_tokens": 1017,

"total_tokens": 1045,

"completion_tokens_details": {

"reasoning_tokens": 836,

"text_tokens": 1017

},

"prompt_tokens_details": {

"text_tokens": 28

}

},

"created": 1776782385,

"system_fingerprint": null,

"model": "qwen3.6-35b-a3b",

"id": "chatcmpl-t1776782378s537r79bca0e43e90ae1726072ca1"

}

可选参数:

- 温度(Temperature)

- Top-P

- Top-K

- 频率惩罚

- 存在惩罚

- 重复惩罚

- Min-P

- Top-A

- 种子

- 最大 tokens 数

- Logit Bias

- 对数概率

- 最高对数概率

- 响应格式

- 结构化输出

- 停止

- 工具

- 工具选择

- 并行工具调用

- 冗长程度

重要提示:由于模型架构不同,部分参数可能仅适用于特定的模型。

温度(Temperature)

-

参数:

temperature -

可选,浮点数,0.0 到 2.0

-

默认:

1.0

此设置影响模型回复的多样性。较低的值会使回复更可预测、更常见;较高的值会鼓励更具多样性且较不常见的回复。当设置为 0 时,模型对相同输入将尽可能的给出相同的回复。

Top-P

-

参数:

top_p -

可选,float,0.0 至 1.0

-

默认值:

1.0

top_p 参数控制模型在生成文本时的候选词选择范围。具体来说,模型会生成一组候选 token,然后从累积概率达到或超过 p 的 token 中随机选择一个作为输出。通过这种方式,top_p 能够在保证生成内容的多样性的同时,考虑到概率分布的合理性。

由于 temperature 与 top_p 均可以控制生成文本的多样性,因此建议您只设置其中一个值。

Top-K

-

参数:

top_k -

可选,int,>= 0

-

默认值:

0

top_k 会限制模型在每一步对 token 的选择,使其从较小的集合中进行选择。值为 1 表示模型将始终选择最有可能的下一个 token,从而得到可预测的结果。

频率惩罚

-

参数:

frequency_penalty -

可选,float,-2.0 至 2.0

-

默认值:

0.0

frequency_penalty 可根据词条在输入中出现的频率来控制其重复使用。它会尝试减少那些在输入中出现频率较高的词条的使用频率,这与它们出现的频率成正比。词条惩罚会随着出现次数的增加而增加。负值将鼓励词条重复使用。

存在惩罚

-

参数:

presence_penalty -

可选,float,-2.0 至 2.0

-

默认值:

0.0

presence_penalty 调整模型重复输入中已使用的特定标记的频率。值越高,重复的可能性就越小,负值则相反。标记惩罚不会随着出现次数而变化。负值会鼓励标记重用。

重复惩罚

-

参数:

repetition_penalty -

可选,float,0.0 至 2.0

-

默认值:

1.0

repetition_penalty 有助于减少输入中标记的重复。较高的值会降低模型重复标记的可能性,但过高的值会使输出不够连贯(通常会出现缺少小词的连续句子)。标记惩罚会根据原始标记的概率进行调整。

Min-P

-

参数:

min_p -

可选,float,0.0 至 1.0

-

默认值:

0.0

min_p 表示某个 token 被考虑的最小概率,该概率是相对于最可能的 token 的概率而言的。如果 min_p 设置为 0.1,则意味着它只允许概率至少为最佳选项十分之一的 token 被考虑。

Top-A

-

参数:

top_a -

可选,float,0.0 到 1.0

-

默认值:

0.0

top_a 仅考虑概率“足够高”的 top tokens,该概率基于最可能的 token 概率。可以将其视为一个动态的 Top-P。较低的 Top-A 值会根据概率最高的 token 集中选择,但范围会更窄。较高的 Top-A 值不一定会影响输出的创造性,但会根据最大概率优化过滤过程。

种子

-

参数:

seed -

可选,int

如果指定了 seed 参数,推理将确定性地进行采样,即使用相同种子和参数的重复请求应该返回相同的结果。某些模型无法保证确定性。

最大 tokens 数

-

参数:

max_tokens -

可选,int,>= 1

max_tokens 可设定模型在响应中可以生成的 token 数量的上限。模型不会生成超过此限制的 token。其最大值等于上下文长度减去 prompt 长度。

Logit Bias

-

参数:

logit_bias -

可选,object

logit_bias 是一个可选参数,用于修改指定 token 在模型生成输出中出现的可能性。

对数概率

-

参数:

logprobs -

可选,boolean

logprobs 设置是否返回输出 token 的对数概率。如果为 true,则返回每个输出 token 的对数概率。

最高对数概率

-

参数:

top_logprobs -

可选,int

top_logprobs 是一个介于 0 和 20 之间的整数,指定在每个 token 位置要返回的最可能 token 的数量,每个 token 都会带有相应的对数概率。如果使用此参数,则必须将 logprobs 设置为 true。

响应格式

-

参数:

response_format -

可选,object

response_format 强制模型产出特定的输出格式。将其设置为 { "type": "json_object" } 可启用 JSON 模式,保证模型生成的消息为有效的 JSON。

注意:使用 JSON 模式时,应同时通过 system 或 user 提示词指示模型生成 JSON。

结构化输出

-

参数:

structured_outputs -

可选,boolean

指示模型是否能够使用 response_format 中的 json_schema 返回结构化输出。

停止

-

参数:

stop -

可选,array

如果模型遇到 stop 数组中指定的任意 token,则立即停止生成。

工具

-

参数:

tools -

可选,array

工具调用参数,遵循 OpenAI 的工具调用请求格式。对于非 OpenAI 提供者,会相应地进行转换。

工具选择

-

参数:

tool_choice -

可选,array

控制模型调用哪个工具。'none' 表示模型不会调用任何工具,而是生成一条消息。'auto' 表示模型可以在生成消息或调用一个或多个工具之间进行选择。'required' 表示模型必须调用一个或多个工具。通过 {"type": "function", "function": {"name": "my_function"}} 指定特定工具会强制模型调用该工具。

并行工具调用

-

参数:

parallel_tool_calls -

可选,boolean

-

默认:true

是否在使用工具时启用并行函数调用。如果为 true,模型可以同时调用多个函数。如果为 false,函数将按顺序依次调用。

冗长程度

-

参数:

verbosity -

可选,enum,

lowmediumhigh -

默认:medium

控制模型响应的冗长程度和长度。较低的值会生成更简洁的回答,而较高的值会生成更详细、更全面的回答。

以上文档为标准版 API 接口文档,可直接用于项目开发和系统调用。如果标准版 API 接口无法满足您的需求,需要定制开发 API 接口,请联系我们的 IT 技术支持工程师:

(沟通需求✅ → 确认技术方案✅ → 沟通费用与工期✅ → 开发&测试✅ → 验收交付✅ → 维护升级✅)